Desafía el Futuro: Descubre Cómo los Chips de Cristal y la IA ‘Libre’ Redefinen la Tecnología

Publicado el 17-03-2026

La vanguardia tecnológica nunca se detiene, y en el horizonte de la inteligencia artificial, dos innovaciones clave prometen transformar radicalmente nuestro mundo: los revolucionarios chips basados en cristal y la urgente demanda de un distintivo para el contenido ‘libre de IA’. Este artículo explora estas y otras tendencias cruciales que están moldeando el futuro digital, desde la eficiencia energética hasta la ética en el ciberespacio.

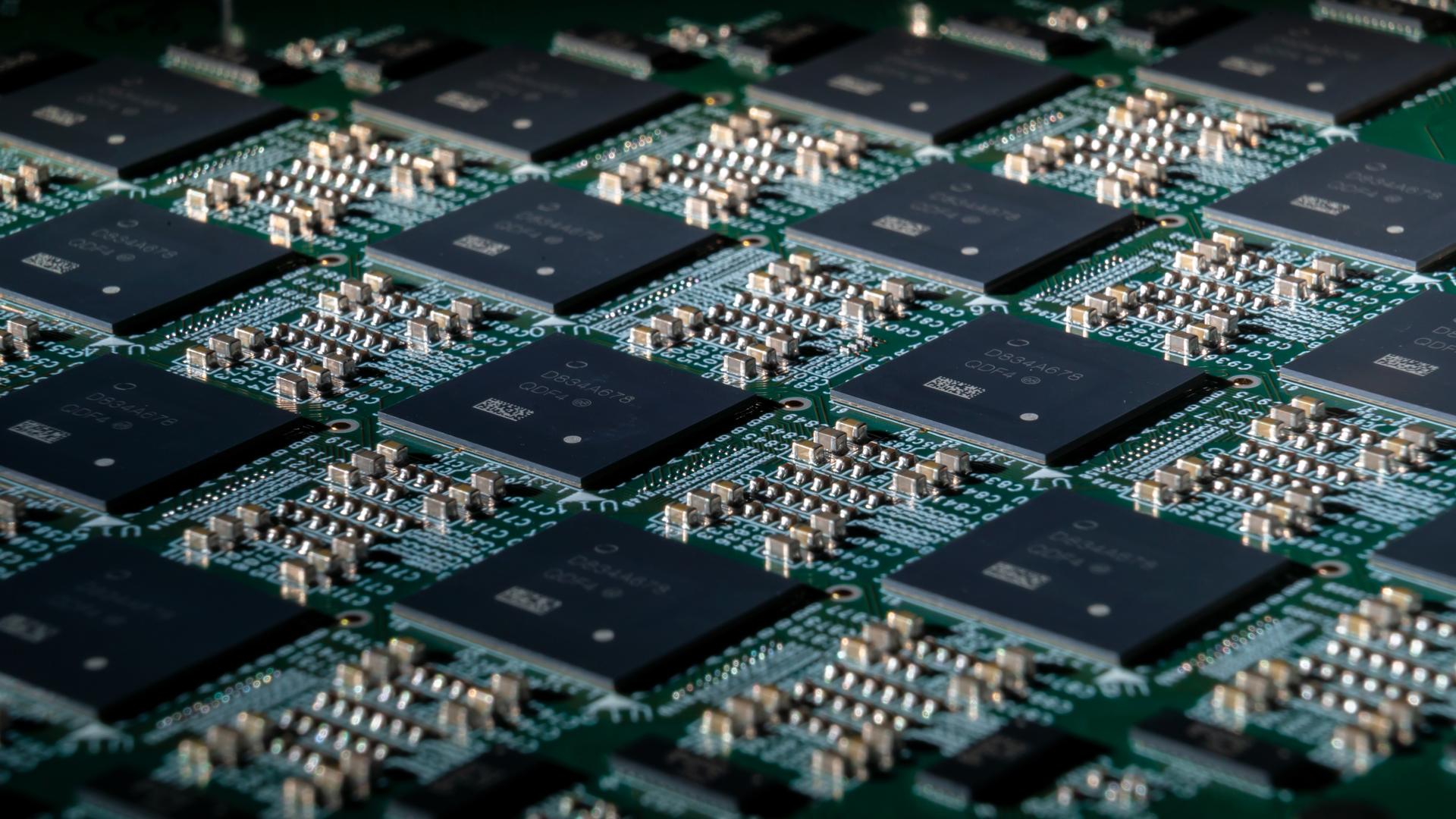

La Revolución Silenciosa: Chips de IA Construidos Sobre Cristal

Durante milenios, el vidrio ha sido un material fundamental en la civilización humana, conocido por su versatilidad y transparencia. Ahora, este antiguo material está a punto de redefinir la arquitectura de los chips de inteligencia artificial, prometiendo una nueva era de eficiencia y rendimiento. Este año, la compañía surcoreana Absolics ha anunciado el inicio de la producción de paneles de vidrio especiales que buscan transformar el hardware de computación de próxima generación, haciéndolo significativamente más potente y energéticamente eficiente. No están solos en esta carrera; gigantes de la industria como Intel también están invirtiendo fuertemente en esta área, reconociendo el potencial transformador del vidrio.

La integración de paneles de vidrio en la fabricación de semiconductores no es solo una novedad; representa una solución crítica a los desafíos actuales de la microelectrónica. A medida que los chips se vuelven más densos y potentes, la disipación de calor y la integridad de la señal se convierten en obstáculos mayores. El vidrio, con sus propiedades térmicas y dieléctricas superiores, ofrece una plataforma ideal para ensamblar componentes de chip de manera más compacta y eficiente. Esto podría conducir a una reducción drástica en la demanda energética de los centros de datos de IA, así como en dispositivos de consumo, desde laptops hasta teléfonos móviles, alargando la vida de la batería y mejorando el rendimiento general. Esta innovación tiene el potencial de impulsar la próxima generación de la computación, haciendo que la IA sea más accesible y sostenible.

La Búsqueda de Autenticidad: El Logo «AI-Free» y los Desafíos Éticos de la IA

A medida que la inteligencia artificial se integra más profundamente en la creación de contenido, desde textos e imágenes hasta música y video, surge una creciente preocupación por la autenticidad. En respuesta, ha estallado una carrera global para establecer un «logo AI-free» universalmente reconocido. Este distintivo permitiría a los consumidores y creadores diferenciar los productos generados íntegramente por humanos de aquellos con algún tipo de intervención de IA, ofreciendo transparencia y construyendo confianza en un paisaje digital cada vez más opaco. Organizaciones de todo el mundo están compitiendo por ser las primeras en desarrollar y estandarizar esta etiqueta, anticipando una demanda masiva por contenido «hecho por humanos». Esta iniciativa refleja una tendencia más amplia hacia la valoración de la originalidad y la autoría en la era de la generación algorítmica.

La campaña «QuitGPT», que insta a las personas a cancelar sus suscripciones a ChatGPT, es un claro indicador de este movimiento. Más allá de la transparencia, la proliferación de la IA también plantea serias cuestiones de seguridad y ética. Recientemente, la senadora Elizabeth Warren exigió explicaciones sobre el acceso de xAI (la startup de Elon Musk) a datos militares clasificados, lo que subraya la preocupación por la implicación de la IA en asuntos de seguridad nacional y toma de decisiones críticas. Además, la dark web ya muestra «modelos de rostro de IA» que buscan participar en estafas románticas, engañando a víctimas y robándoles dinero en lo que se conoce como «pig butchering scams». Estos incidentes resaltan la doble cara de la innovación: mientras la IA promete avances sin precedentes, también abre nuevas avenidas para el fraude y la manipulación, haciendo indispensable un marco ético robusto y una vigilancia constante.

Impacto Económico y Geopolítico de la IA: De los Despidos a la Competencia Global

El auge de la inteligencia artificial no solo está redefiniendo la tecnología, sino que también está remodelando el panorama económico y laboral a nivel global. Un ejemplo palpable es la reciente planificación de Meta de realizar despidos masivos, que podrían afectar a más del 20% de su personal. Esta drástica medida busca compensar los elevados costos asociados con su ambiciosa apuesta por la IA, señalando cómo incluso los gigantes tecnológicos deben balancear sus inversiones en investigación y desarrollo con la sostenibilidad operativa. Este escenario reaviva el debate sobre el impacto de la automatización y la IA en el mercado laboral, una preocupación que, como la historia ha demostrado, ha acompañado a cada revolución tecnológica.

En el frente geopolítico, la competencia en IA se intensifica. ByteDance, la empresa matriz de TikTok, retrasó el lanzamiento de un modelo de IA de video avanzado tras disputas sobre derechos de autor, especialmente después de que generara imágenes convincentes de figuras públicas. Este incidente destaca la creciente complejidad de la propiedad intelectual en la era de la IA generativa. Simultáneamente, el ecosistema de startups de IA en China experimenta un crecimiento exponencial, con una de ellas alcanzando una valoración de 18 mil millones de dólares en solo tres meses, superando las expectativas y demostrando la rápida expansión y maduración de los modelos de IA de código abierto chinos. Este dinamismo subraya la naturaleza global de la carrera por la supremacía en IA, con implicaciones significativas para la innovación, la economía y la geopolítica mundial.

Horizontes de Innovación: Desafíos Digitales y la Resurrección de Especies

Más allá de los chips y las políticas de IA, el mundo tecnológico bulle con innovaciones y debates que apuntan a un futuro cada vez más complejo y fascinante. Un concepto que está ganando tracción es la lucha contra la «enshittification», un término popularizado para describir la degradación gradual de la calidad de las plataformas en línea a medida que priorizan las ganancias sobre la experiencia del usuario. Países como Noruega se están uniendo a una campaña global para contrarrestar este fenómeno, abogando por un internet más abierto, justo y menos dominado por grandes corporaciones. Este movimiento busca una reevaluación de cómo interactuamos con las plataformas digitales y cómo se construyen, sugiriendo la necesidad de trascender los modelos actuales hacia ecosistemas digitales más sostenibles y centrados en el usuario.

En la intersección de la biología y la tecnología, la biotecnología nos empuja a los límites de lo posible con planes audaces para la «desextinción». Un ejemplo asombroso es el proyecto de una startup que busca resucitar al dodo, una especie extinta hace casi 400 años, a través de la edición genética avanzada. Este tipo de iniciativas, aunque controvertidas, ilustran el inmenso poder de las tecnologías modernas para alterar y restaurar el mundo natural. Paralelamente, en el ámbito de la computación, se está gestando un «moonshot» para la próxima era. El gobierno de EE. UU. está organizándose para impulsar nuevas fronteras computacionales, incluyendo la computación cuántica, neuromórfica y reversible. La clave del éxito, según expertos, reside en adoptar un enfoque audaz inspirado en DARPA, que se centre en programas de investigación de alto riesgo y alta recompensa para asegurar una ventaja tecnológica duradera. La combinación de estos frentes de innovación –desde la lucha por una web mejor hasta la reimaginación de la vida y la computación– dibuja un panorama de un futuro donde la tecnología no solo redefine lo que podemos hacer, sino también lo que somos.

Conclusión: La tecnología avanza a pasos agigantados, trayendo consigo tanto promesas transformadoras como desafíos éticos y sociales. Desde los chips de cristal que impulsarán la eficiencia de la IA, hasta la creciente necesidad de distinguir entre creaciones humanas y algorítmicas, pasando por las implicaciones geopolíticas y las fronteras de la biotecnología, estamos en un momento decisivo. Es crucial que como sociedad, y como profesionales del sector, abordemos estas innovaciones con una mezcla de entusiasmo y prudencia, forjando un futuro donde la tecnología sirva al bienestar humano de manera responsable y sostenible.

Fuente original: The Download: glass chips and “AI-free” logos